Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

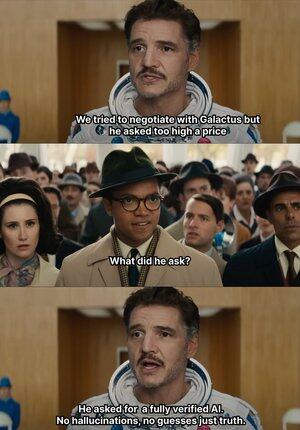

Коли ШІ починає миритися наосліп, @Mira_Network прямо піднімає руку і ляскає 😂 по ній

Цікаво, що у 2023 році старший юрист із Нью-Йорка подав до федерального суду юридичний висновок

Дані начебто не мають недоліків, але суддя розгледів їх з першого погляду, і жодної зі справ, перелічених у статті, не існувало, але я не очікував, що їх сфабрикує ChatGPT

З 2023 року OpenAI став основним генеративним інструментом для нашого офісного навчання

До цього мені зазвичай доводилося шукати Baidu та Google, щоб знайти інформацію, але зараз мені потрібен лише GPT для її узагальнення

Таким чином, у мене виробилася звичка тягнутися за їжею, і мені ліньки перевіряти її автентичність і безпосереднє прийняття

Навіть якщо штучний інтелект вигадає, ніхто не знає, правда це чи брехня, на світ з'явиться багато інцидентів улунів

Тому що поки мова гладка і логічна, вона може обдурити переважну більшість людей

Але насправді такі речі не можуть повністю покладатися на ШІ, ШІ видає все більше і більше, але здатність до верифікації майже стагнує, і проблема галюцинацій стала структурним ризиком

Саме в цьому контексті мережа перевірки вихідного сигналу штучного інтелекту @Mira_Network стала жорсткою потребою

@Mira_Network Створіть мережу верифікації, що складається з кількох моделей, і використовуйте перехресне судження між системами, щоб компенсувати проблему, яку одна модель не може сертифікувати самостійно

▪️ Першим кроком є розбиття твердження на частини

Будь-який складний вихід розбивається на ряд більш базових тверджень

Наприклад, Земля обертається навколо Сонця, а Місяць обертається навколо Землі на два незалежні твердження, кожне з яких можна судити окремо про істинність або хибність

Далі до процесу верифікації підключається кілька моделей, і кожна модель виносить судження самостійно, а система порахує ступінь консенсусу між ними та оцінить ступінь довіри

Якщо консенсус перевищує поріг, вимога вважається обґрунтованою; Якщо розбіжності серйозні, спрацьовує повторна перевірка або звільнення

▪️ Дані тестової валідації Mira показують:

> Механізм консенсусу з трьох моделей підвищує точність з 73,1% до 95,6%

> зниження загального показника помилок на 84%

> Середнє значення узгодженості κ між кількома моделями близьке до 0,8, що має стійку здатність судження

Звичайно, якщо ви просто дозволите кільком моделям проголосувати, щоб судити правду, легко вгадати випадково

▪️Mira працює, тому що вбудовує ігрову механіку в структуру системи

Валідація не є безкоштовним актом. Кожен вузол моделі, що бере участь у валідації, повинен нести відповідальність за результати

Якщо він часто суперечить судженням інших вузлів або виявляється, що він значно відхиляється від логічної траєкторії, він втратить свої права на валідацію та втратить економічні стимули в мережі

Для того, щоб верифікація дійсно була реалізована, Mira зробила безліч інженерних оптимізацій в архітектуру виконання

▪️ Найбільш критичним з них є стиснення вихідних даних валідації в один токен

Ця технологія трансформації заяв різко знижує вартість перевірки, дозволяючи системі працювати в масштабних випадках використання без уповільнення пропускної здатності

▪️ На рівні конфіденційності валідатори Mira ніколи не торкаються повного тексту

Система автоматично розбиває контент і розподіляє його по різних вузлах, щоб забезпечити незвідність даних в процесі верифікації

За останній рік ШІ підштовхували до все нових і нових сценаріїв, і швидкість генерації прискорювалася, але механізм верифікації в основному застоявся

Штучний інтелект не буде притягнутий до відповідальності, але люди будуть 😭 відповідати

Отже, роль @MiraNetworkCN полягає в тому, щоб зупинити штучний інтелект, коли він завдає кілька сліпих ударів

2,17K

Найкращі

Рейтинг

Вибране