Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

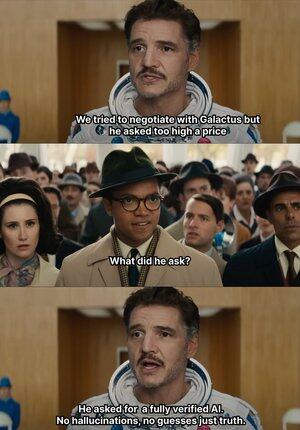

Kiedy AI zaczyna bzdurzyć, @Mira_Network od razu daje mu w twarz 😂

Opowiem coś ciekawego, w 2023 roku do sądu federalnego złożono opinię prawną przez doświadczonego prawnika z Nowego Jorku.

Dokument wyglądał na wiarygodny, ale sędzia od razu dostrzegł, że wszystkie przytoczone przypadki nie istnieją, okazało się, że to wszystko zostało wymyślone przez ChatGPT.

Od 2023 roku OpenAI stało się głównym narzędziem generacyjnym w naszej pracy i nauce.

Przedtem, gdy szukałem informacji, musiałem przeszukiwać Baidu i Google, teraz wystarczy, że poproszę GPT o podsumowanie.

Z czasem przyzwyczaiłem się do tego, że jedzenie przychodzi do ust, a ubrania same się zakładają, więc nie chce mi się weryfikować prawdziwości, tylko od razu korzystam.

AI, nawet jeśli bzdurzy, nikt nie wie, co jest prawdą, a co nie, co prowadzi do wielu nieporozumień.

Bo wystarczy, że język jest płynny, a logika sensowna, aby oszukać większość ludzi.

Ale w rzeczywistości nie można całkowicie obwiniać AI, jego wyniki rosną, ale zdolność weryfikacji prawie się zatrzymała, a problem halucynacji stał się ryzykiem strukturalnym.

W tym kontekście sieć weryfikacji wyników AI @Mira_Network stała się niezbędna.

@Mira_Network buduje sieć weryfikacyjną składającą się z wielu modeli, wykorzystując krzyżowe oceny między systemami, aby zrekompensować problem braku samoweryfikacji pojedynczego modelu.

▪️ Pierwszym krokiem jest rozbicie stwierdzenia.

Każdy złożony wynik zostanie rozłożony na szereg bardziej podstawowych twierdzeń.

Na przykład: Ziemia krąży wokół Słońca, Księżyc krąży wokół Ziemi, zostanie rozdzielone na dwa niezależne zdania, z których każde można ocenić oddzielnie.

Następnie wiele modeli wchodzi w proces weryfikacji, każdy model niezależnie wydaje osąd, a system zlicza stopień ich konsensusu i ocenia poziom zaufania.

Jeśli konsensus przekracza próg, to twierdzenie uznaje się za ważne; jeśli różnice są poważne, uruchamiana jest druga kontrola lub odrzucenie.

▪️ Dane z testów weryfikacyjnych Mira pokazują:

> Mechanizm konsensusu trzech modeli zwiększa dokładność z 73,1% do 95,6%.

> Całkowity wskaźnik błędów spada o 84%.

> Średnia zgodność między modelami κ wynosi blisko 0,8, co zapewnia stabilną zdolność oceny.

Oczywiście, jeśli tylko pozwolimy wielu modelom głosować w sprawie prawdziwości, łatwo może dojść do losowych zgadywań.

▪️ Mira działa, ponieważ wbudowano mechanizm gry w strukturę systemu.

Weryfikacja nie jest działaniem bezkosztowym. Każdy model uczestniczący w weryfikacji musi ponosić odpowiedzialność za wyniki.

Jeśli często dochodzi do konfliktów w ocenach z innymi modelami lub zostanie wykryta wyraźna odchylenie od logicznego toku, straci prawo do weryfikacji i utraci ekonomiczne zachęty w sieci.

Aby weryfikacja naprawdę się powiodła, Mira przeprowadziła wiele optymalizacji inżynieryjnych w architekturze wykonawczej.

▪️ Najważniejszym krokiem jest: kompresja wyników weryfikacji do pojedynczego tokena.

Ta technologia transformacji roszczeń znacznie obniża koszty każdej weryfikacji, umożliwiając systemowi działanie w dużych zastosowaniach bez przeciążania.

▪️ W zakresie prywatności, węzły weryfikacyjne Mira nigdy nie mają dostępu do pełnych tekstów.

System automatycznie dzieli treść i rozdziela ją do różnych węzłów, zapewniając nieodwracalność danych w procesie weryfikacji.

W ciągu ostatniego roku AI zostało wprowadzone do coraz większej liczby scenariuszy, a tempo generacji stale rośnie, ale mechanizmy weryfikacji praktycznie stanęły w miejscu.

AI może pleść bzdury i nie ponosić odpowiedzialności, ale ludzie tak 😭

Dlatego rola @MiraNetworkCN polega na tym, aby móc interweniować, gdy AI zaczyna bzdurzyć.

2,2K

Najlepsze

Ranking

Ulubione