热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

过去的一周对于人工智能实用程序主题来说意义重大。

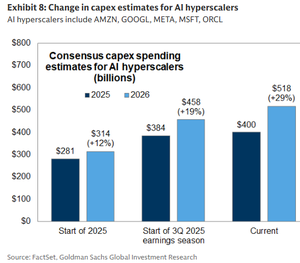

超大规模企业的收益都指向一件事,即需求领先于电源、机架和芯片,这直接为独立人工智能计算提供商奠定了下一步。

$AMZN显示,AWS 以 $20B 的运行率重新加速至 132%,积压订单接近 $200B。他们去年增加了 3.8 吉瓦的电力,预计到 2027 年将再次翻一番。AWS 未按时交付的每一兆瓦都会被第三方 GPU 基础设施填补。

$MSFT表示,今年人工智能容量将增长 80%,他们的整个数据中心占地面积将在两年内翻一番。即使在上个季度在资本支出上花费了 $26B 之后,它们在 35 财年期间的产能也受到限制,这意味着需求正在溢出到可以更快或更便宜地部署的非超大规模计算提供商。

$GOOGL云积压达到 $155B,环比增长 40%,管理层表示,到 2026 年,它们的供应仍然受到限制。这承认人工智能的建设速度超过了电力、芯片和数据中心上线的速度。

$META将 71 年的资本支出提高到 $2025B,并表示 2026 年将“明显更大”。他们在构建自己的 GPU 容量的同时租用外部 GPU 容量,这验证了独立 GPU 提供商的经济性,这些提供商可以自己为超大规模企业提供计算。

这是专业基础设施参与者占据份额的时刻:

• $CRWV高密度 GPU 云,专为大规模 AI 训练而构建

• $CIFR AI 租户的电力优势数据中心房东

• 在成本最低的能源区域$WULF基本负荷计算

• $APLD模块化园区的部署速度比传统建筑更快

• $IREN成本最低的可再生能源,每 GPU 小时的成本最低

• $NBIS企业级 GPU 集群提供计算,无需超大规模锁定

下一阶段的人工智能基础设施属于谁能够以每兆瓦最快、最高效的方式部署计算。

热门

排行

收藏