热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

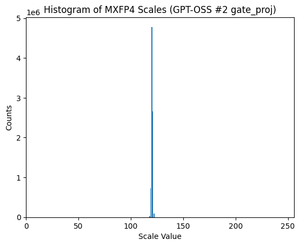

GPT-OSS 使用 MXFP4 量化(MLX 现在支持)。

目前有两种 FP4 格式在流通:MXFP4 和 NVFP4(NV 代表 Nvidia)。

从 GPT-OSS 使用 MXFP4 的方式来看,它有些不够优化。我认为 NVFP4 将是未来更常用的格式。

更多细节如下:

这两种格式将权重量化为 4 位浮点数(e2 m1),每组有一个独特的缩放比例。

区别在于组大小和每组的缩放比例编码方式。

- MXFP4 使用 e8m0 缩放(定点,8 位),组大小为 32。在乘以权重之前,它会被提升到 2 的幂。

- NVFP4 使用 e4m3(fp8)缩放,组大小为 16。它直接与权重相乘。

MXFP4 中的缩放编码相当不够优化,因为它没有很多我们需要的值的表示。

事实上,如果你查看 GPT-OSS 的缩放分布,它极其集中在仅几个值周围。例如,对于我正在查看的第二个 MoE 层,只有 8/256 个可能的值被使用。(见图)。

17.06K

热门

排行

收藏