Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

DLLM выглядят многообещающе... но параллельная генерация не всегда возможна

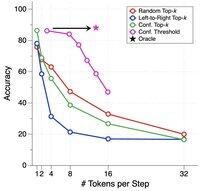

Модели на основе диффузии могут генерировать много токенов на разных позициях одновременно, в то время как большинство авторегрессионных моделей генерируют токены по одному.

Это делает модели на основе диффузии очень привлекательными, когда нам нужна быстрая генерация с меньшими вычислительными затратами.

Большой вопрос заключается в том, возможно ли параллельное генерирование без потери точности моделирования?

Ответ - нет. Существуют фундаментальные ограничения на то, сколько параллелизма мы можем достичь.

Рассмотрим этот пример:

"Выберите один город равномерно случайным образом из следующих четырех городов:

Нью-Йорк, Новый Орлеан, Мехико или Панама-Сити."

Тогда,

P(Y₁ = New, Y₂ = York) = 1/4,

P(Y₁ = New, Y₂ = Orleans) = 1/4 и так далее.

Таким образом, P(Y₁ = New) = 1/2, P(Y₂ = City) = 1/2.

Если вы решите генерировать Y₁ и Y₂ параллельно, независимо от того, какой алгоритм декодирования вы используете …

Вы обречены на выбор "Новый Город."

Ни одна из современных DLLM не может правильно сгенерировать эти два слова без отказа от параллелизма.

-----

Почему это так?...

Топ

Рейтинг

Избранное