Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

DLLM-urile par promițătoare... Dar generarea paralelă nu este întotdeauna posibilă

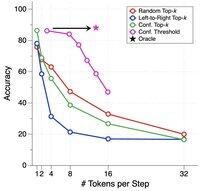

LLM-urile bazate pe difuzie pot genera mai multe token-uri în diferite poziții simultan, în timp ce majoritatea LLM-urilor autoregresive generează token-uri unul câte unul.

Acest lucru face ca LLM-urile bazate pe difuzie să fie extrem de atractive atunci când avem nevoie de generare rapidă cu mai puțin calcul.

O mare întrebare este... Este posibilă generarea paralelă fără a pierde acuratețea modelării?

Răspunsul este nu. Există limite fundamentale în ceea ce privește cât de mult paralelism putem obține.

Luați în considerare acest exemplu:

"Alegeți un oraș uniform la întâmplare din următoarele patru orașe:

New York, New Orleans, Mexico City sau Panama City".

Apoi

P(Y₁ = Nou, Y₂ = York) = 1/4,

P(Y₁ = Nou, Y₂ = Orleans) = 1/4 și așa mai departe.

Astfel, P(Y₁ = Nou) = 1/2, P(Y₂ = Oraș) = 1/2.

Dacă alegeți să generați Y₁ și Y₂ în paralel, indiferent de algoritmul de decodare pe care îl utilizați ...

Ești condamnat să probezi "New City".

Niciunul dintre DLLM-urile de astăzi nu poate genera corect aceste două cuvinte fără a renunța la paralelism.

-----

De ce se întâmplă acest lucru?...

Limită superioară

Clasament

Favorite