Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Unternehmen bauen RAG über Hunderte von Datenquellen, nicht nur eine!

- Microsoft liefert es in M365-Produkten.

- Google liefert es in seiner Vertex AI Search.

- AWS liefert es in seinem Amazon Q Business.

Lass uns ein MCP-gestütztes RAG über 200+ Quellen (100% lokal) aufbauen:

Unternehmensdaten sind über viele Quellen verstreut.

Heute werden wir einen einheitlichen MCP-Server erstellen, der über eine Schnittstelle auf über 200 Quellen zugreifen kann.

Technologiestack:

- @mcpuse, um einen lokalen MCP-Client zu erstellen

- @MindsDB, um eine Verbindung zu Datenquellen herzustellen

- @ollama, um GPT-oss lokal bereitzustellen

Lass uns anfangen!

Hier ist der Arbeitsablauf:

- Der Benutzer reicht eine Anfrage ein.

- Der Agent verbindet sich mit dem MindsDB MCP-Server, um Werkzeuge zu finden.

- Wählt das geeignete Werkzeug basierend auf der Anfrage des Benutzers aus und ruft es auf.

- Schließlich gibt es eine kontextuell relevante Antwort zurück.

Jetzt tauchen wir in den Code ein!

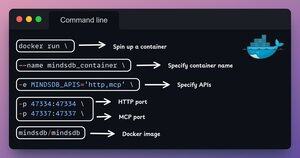

1️⃣ Docker-Setup

MindsDB bietet Docker-Images, die in Docker-Containern ausgeführt werden können.

Installiere MindsDB lokal mit dem Docker-Image, indem du den Befehl in deinem Terminal ausführst.

Sieh dir das an 👇

2️⃣ Starte die MindsDB GUI

Nachdem du das Docker-Image installiert hast, gehe in deinem Browser zu localhost Port 47334, um auf den MindsDB-Editor zuzugreifen.

Über diese Schnittstelle kannst du dich mit über 200 Datenquellen verbinden und SQL-Abfragen gegen sie ausführen.

Sieh dir das an 👇

3️⃣ Integriere Datenquellen

Lass uns damit beginnen, unsere föderierte Abfrage-Engine zu erstellen, indem wir unsere Datenquellen mit MindsDB verbinden.

Wir verwenden Slack, Gmail, GitHub und Hacker News als unsere föderierten Datenquellen.

Sieh dir das an 👇

4️⃣ MCP-Serverkonfiguration

Nachdem wir die föderierte Abfrage-Engine erstellt haben, lassen Sie uns unsere Datenquellen vereinheitlichen, indem wir sie mit dem MCP-Server von MindsDB verbinden.

Fügen Sie die MCP-Serverkonfiguration einer JSON-Datei hinzu, wie unten gezeigt.

Schauen Sie sich das an 👇

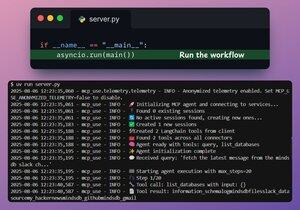

5️⃣ Verbinde Client mit Server

Wir richten unseren lokalen Client über mcp-use ein und verbinden ihn mit dem MCP-Server mit nur 4 Zeilen Code.

1. Initialisiere MCP-Client aus einer Konfigurationsdatei.

2. Verbinde lokalen LLM über Ollama.

3. Erstelle Agenten mit LLM und Client.

4. Führe die Abfrage aus.

Überprüfe dies 👇

Fertig!

Unser MindsDB MCP-Server ist jetzt über mcp-use mit einem lokalen Client verbunden!

Er bietet zwei Werkzeuge:

- list_databases: Listet alle Datenquellen auf, die mit MindsDB verbunden sind.

- query: Beantwortet Benutzeranfragen zu den föderierten Daten.

Überprüfen Sie das 👇

Zuletzt verpacken wir unser Setup in eine Streamlit-Oberfläche, wo wir die MCP-Konfiguration dynamisch ändern und direkt mit dem Agenten chatten können.

Schau dir diese Demo an👇

Das war's!

Wenn du es aufschlussreich fandest, teile es mit deinem Netzwerk.

Finde mich → @_avichawla

Jeden Tag teile ich Tutorials und Einblicke zu DS, ML, LLMs und RAGs.

8. Aug., 14:33

Unternehmen bauen RAG über Hunderte von Datenquellen, nicht nur eine!

- Microsoft liefert es in M365-Produkten.

- Google liefert es in seiner Vertex AI Search.

- AWS liefert es in seinem Amazon Q Business.

Lass uns ein MCP-gestütztes RAG über 200+ Quellen (100% lokal) aufbauen:

105,02K

Top

Ranking

Favoriten