المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

4 مراحل من تدريب LLMs من البداية ، موضحة بوضوح (مع المرئيات):

اليوم ، نغطي 4 مراحل لبناء LLMs من البداية لجعلها قابلة للتطبيق في حالات الاستخدام في العالم الحقيقي.

سنغطي:

- التدريب المسبق

- ضبط التعليمات

- الضبط الدقيق للتفضيل

- الضبط الدقيق للمنطق

يلخص المرئي هذه التقنيات.

دعنا نتعمق في!

0️⃣ LLM مهيأة عشوائيا

في هذه المرحلة ، لا يعرف النموذج شيئا.

تسأل "ما هو LLM؟" وتحصل على هراء مثل "جرب بيتر هاند ومرحبا 448Sn".

لم تر أي بيانات حتى الآن وتمتلك أوزان عشوائية فقط.

تحقق من هذا 👇

1️⃣ التدريب المسبق

تعلم هذه المرحلة LLM أساسيات اللغة من خلال تدريبها على مجموعات ضخمة للتنبؤ بالرمز المميز التالي. بهذه الطريقة ، تمتص القواعد والحقائق العالمية وما إلى ذلك.

لكنها ليست جيدة في المحادثة لأنه عندما يطلب منها ذلك ، فإنها تستمر فقط في النص.

تحقق من هذا 👇

2️⃣ ضبط التعليمات

لجعلها محادثة ، نقوم بضبط التعليمات من خلال التدريب على أزواج التعليمات والاستجابة. يساعده هذا في تعلم كيفية اتباع المطالبات وتنسيق الردود.

الآن يمكنها:

- أجب عن الأسئلة

- تلخيص المحتوى

- اكتب التعليمات البرمجية ، إلخ.

تحقق من هذا 👇

في هذه المرحلة ، من المحتمل أن يكون لدينا:

- استخدم أرشيف الإنترنت الخام والمعرفة بالكامل.

- ميزانية بيانات استجابة التعليمات المسماة من قبل الإنسان.

إذن ما الذي يمكننا فعله لزيادة تحسين النموذج؟

ندخل في منطقة التعلم المعزز (RL).

دعنا نتعلم بعد ذلك 👇

3️⃣ ضبط التفضيل الدقيق (PFT)

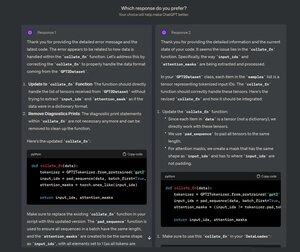

يجب أن تكون قد شاهدت هذه الشاشة على ChatGPT حيث تسأل: ما هي الاستجابة التي تفضلها؟

هذا ليس فقط للتعليقات ولكنه بيانات تفضيل بشرية قيمة.

يستخدم OpenAI هذا لضبط نماذجهم باستخدام الضبط الدقيق للتفضيلات.

تحقق من هذا 👇

في PFT:

يختار المستخدم من بين 2 ردود لإنتاج بيانات التفضيل البشري.

ثم يتم تدريب نموذج المكافأة للتنبؤ بالتفضيل البشري ويتم تحديث LLM باستخدام RL.

تحقق من هذا 👇

تسمى العملية المذكورة أعلاه RLHF (التعلم المعزز مع التغذية الراجعة البشرية) والخوارزمية المستخدمة لتحديث أوزان النموذج تسمى PPO.

إنه يعلم LLM التوافق مع البشر حتى في حالة عدم وجود إجابة "صحيحة".

ولكن يمكننا تحسين LLM أكثر.

دعنا نتعلم بعد ذلك👇

4️⃣ الاستدلال ، الضبط الدقيق

في مهام التفكير (الرياضيات والمنطق وما إلى ذلك) ، عادة ما تكون هناك استجابة واحدة صحيحة وسلسلة محددة من الخطوات للحصول على الإجابة.

لذلك لا نحتاج إلى تفضيلات بشرية ، ويمكننا استخدام الصواب كإشارة.

وهذا ما يسمى الضبط👇 الدقيق للمنطق

الخطوات:

- يقوم النموذج بإنشاء إجابة على مطالبة.

- تتم مقارنة الإجابة بالإجابة الصحيحة المعروفة.

- بناء على الصحة ، نقوم بتعيين مكافأة.

وهذا ما يسمى التعلم المعزز مع مكافآت يمكن التحقق منها.

GRPO من DeepSeek هي تقنية شائعة.

تحقق من هذا👇

كانت تلك هي 4 مراحل لتدريب ماجستير في القانون من الصفر.

- ابدأ بنموذج تمت تهيئته عشوائيا.

- قم بتدريبه مسبقا على مجموعات واسعة النطاق.

- استخدم ضبط التعليمات الدقيقة لجعلها تتبع الأوامر.

- استخدم التفضيل والضبط الدقيق لشحذ الاستجابات.

تحقق من هذا 👇

إذا وجدت أنها ثاقبة ، فأعد مشاركتها مع شبكتك.

ابحث عني → @_avichawla

كل يوم ، أشارك البرامج التعليمية والرؤى حول DS و ML و LLMs و RAGs.

21 يوليو 2025

4 مراحل من تدريب LLMs من البداية ، موضحة بوضوح (مع المرئيات):

@tasiorek27 الضبط الدقيق لتعزيز:

ضبط التعليمات: (لا يتعلق الأمر بالتدريب في حد ذاته من خلال إنشاء مجموعة بيانات لضبط التعليمات)

6 مايو 2025

دعنا ننشئ مجموعة بيانات الضبط الدقيق الخاصة بنا (محلي 100٪):

714.16K

الأفضل

المُتصدِّرة

التطبيقات المفضلة