Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Esse artigo me 🤯 chocou

Todo mundo no X fica se gabando de "LLM-como-juiz" como se fosse um oráculo mágico da verdade.

Mas este artigo mostra algo insano:

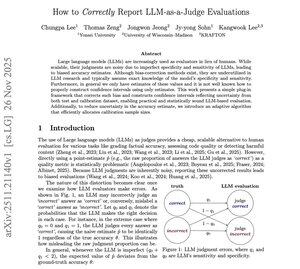

A maioria das avaliações de LLMs que você viu é tendenciosa pelo design não porque os modelos sejam ruins, mas porque o próprio juiz discretamente deturpa a nota.

Aqui vem a parte mais louca:

Se um juiz for um pouco ruim em detectar respostas erradas (baixa especificidade), isso infla a precisão.

Se ele for um pouco ruim em reconhecer respostas corretas (baixa sensibilidade), isso diminui a precisão.

Mesmo modelo. Mesmas saídas.

Mas você tem dois juízes diferentes = duas "precisões" diferentes.

Os autores mostram a matemática, as curvas de erro e o ponto exato em que o juiz começa a mentir para você sem querer.

Então eles construíram uma correção:

Um estimador plug-in que ajusta a pontuação julgada de volta para a pontuação real usando dados de calibração.

Além de um intervalo de confiança que finalmente reflete a incerteza tanto do conjunto de avaliação quanto do conjunto de calibração.

Aqui está o que me chocou:

Eles até mostram como alocar amostras de calibração de forma eficiente para que você não desperdiça orçamento, algo que ninguém na avaliação de LLM fala.

...

Melhores

Classificação

Favoritos