Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

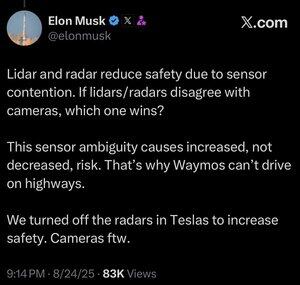

Jag är inte säker på att det är vettigt. Visst, Elon är mycket smartare än mig, men här är mina 2 cent:

Jag tror inte att sensorfusion är omöjligt, det gör bara systemet mycket mer komplicerat. Jag kan se ett föremål, röra vid det, lukta på det, och min hjärna kan smälta samman det helt naturligt. Jag tror inte att sensorfusion i sig är mindre säkert, men det ökar komplexiteten i systemet och ökar antalet felpunkter. Teslas största problem var att deras radar i bilen var så lågupplöst.

Waymo kan inte köra på motorvägar med kunder ännu, delvis på grund av LIDAR-sensorernas räckvidd och inställningen för höghastighetskörning. Och på grund av den extra risken med höga hastigheter. Men de kör faktiskt på motorvägar nu utan någon i förarsätet och låter de anställda leka med det. Så jag tycker inte att det är rättvist att säga att de inte kan köra på motorvägar, de känner sig bara inte bekväma med att låta kunderna använda det ännu.

Mitt favoritargument för varför djupinlärning slår en metod med flera sensorer är att den storskaliga datamängden som du kan bygga med en enda sensormodalitet till låg kostnad är extremt kraftfull för att öka modellens prediktiva noggrannhet. Du kanske har alla dessa snygga sensorer, men om det innebär att din datauppsättning är en bråkdel av storleken, mångfalden osv. kan en modell med endast vision faktiskt överträffa i prediktiv noggrannhet och därmed säkerhet.

Jag håller med honom om att syn bara är bättre, men tror inte att kruxet med det är sensorfusion

232,38K

Topp

Rankning

Favoriter