Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Qui a inventé les réseaux de neurones convolutionnels (CNN) ?

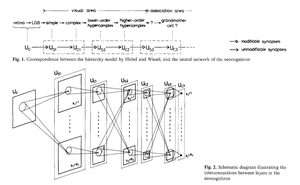

1969 : Fukushima avait des ReLUs pertinents pour les CNN [2].

1979 : Fukushima avait l'architecture de base des CNN avec des couches de convolution et des couches de sous-échantillonnage [1]. Le coût de calcul était 100 fois plus élevé qu'en 1989, et un milliard de fois plus élevé qu'aujourd'hui.

1987 : Waibel a appliqué la rétropropagation de Linnainmaa de 1970 [3] aux TDNN à partage de poids avec des convolutions 1-dimensionnelles [4].

1988 : Wei Zhang et al. ont appliqué des CNN 2-dimensionnels entraînés par rétropropagation "modernes" à la reconnaissance de caractères [5].

Tout ce qui précède a été publié au Japon entre 1979 et 1988.

1989 : LeCun et al. ont de nouveau appliqué les CNN à la reconnaissance de caractères (codes postaux) [6,10].

1990-93 : Le sous-échantillonnage de Fukushima basé sur l'averaging spatial [1] a été remplacé par le max-pooling pour les TDNN 1-D (Yamaguchi et al.) [7] et les CNN 2-D (Weng et al.) [8].

2011 : Beaucoup plus tard, mon équipe avec Dan Ciresan a rendu les CNN avec max-pooling vraiment rapides sur les GPU NVIDIA. En 2011, DanNet a atteint le premier résultat de reconnaissance de motifs surhumain [9]. Pendant un certain temps, il a bénéficié d'un monopole : de mai 2011 à septembre 2012, DanNet a remporté tous les défis de reconnaissance d'images auxquels il a participé, 4 d'entre eux consécutivement. Il est vrai, cependant, que cela concernait principalement l'ingénierie et l'augmentation des idées de base du millénaire précédent, profitant d'un matériel beaucoup plus rapide.

Certains "experts en IA" affirment que "faire fonctionner les CNN" (par exemple, [5,6,9]) était aussi important que de les inventer. Mais "les faire fonctionner" dépendait en grande partie de la richesse de votre laboratoire pour acheter les derniers ordinateurs nécessaires pour augmenter le travail original. C'est la même chose qu'aujourd'hui. Recherche fondamentale contre ingénierie/développement - la R contre le D dans la R&D.

RÉFÉRENCES

[1] K. Fukushima (1979). Modèle de réseau de neurones pour un mécanisme de reconnaissance de motifs non affecté par un déplacement de position — Neocognitron. Trans. IECE, vol. J62-A, no. 10, pp. 658-665, 1979.

[2] K. Fukushima (1969). Extraction de caractéristiques visuelles par un réseau multicouche d'éléments seuils analogiques. IEEE Transactions on Systems Science and Cybernetics. 5 (4) : 322-333. Ce travail a introduit les unités linéaires rectifiées (ReLUs), maintenant utilisées dans de nombreux CNN.

[3] S. Linnainmaa (1970). Mémoire de maîtrise, Univ. Helsinki, 1970. La première publication sur la rétropropagation "moderne", également connue sous le nom de mode inverse de la différentiation automatique. (Voir l'aperçu bien connu de la rétropropagation de Schmidhuber : "Qui a inventé la rétropropagation ?")

[4] A. Waibel. Reconnaissance de phonèmes utilisant des réseaux de neurones à retard. Réunion de l'IEICE, Tokyo, Japon, 1987. Rétropropagation pour un TDNN à partage de poids avec des convolutions 1-dimensionnelles.

[5] W. Zhang, J. Tanida, K. Itoh, Y. Ichioka. Réseau de neurones de reconnaissance de motifs invariant au déplacement et son architecture optique. Proc. Conférence annuelle de la Japan Society of Applied Physics, 1988. Premier CNN 2-dimensionnel entraîné par rétropropagation, avec des applications à la reconnaissance de caractères anglais.

[6] Y. LeCun, B. Boser, J. S. Denker, D. Henderson, R. E. Howard, W. Hubbard, L. D. Jackel : Rétropropagation appliquée à la reconnaissance de codes postaux manuscrits, Neural Computation, 1(4) :541-551, 1989. Voir aussi Sec. 3 de [10].

[7] K. Yamaguchi, K. Sakamoto, A. Kenji, T. Akabane, Y. Fujimoto. Un réseau de neurones pour la reconnaissance de mots isolés indépendamment du locuteur. Première conférence internationale sur le traitement du langage parlé (ICSLP 90), Kobe, Japon, nov. 1990. Un TDNN 1-dimensionnel utilisant le Max-Pooling au lieu de l'averaging spatial de Fukushima [1].

[8] Weng, J., Ahuja, N., et Huang, T. S. (1993). Apprentissage de la reconnaissance et de la segmentation d'objets 3-D à partir d'images 2-D. Proc. 4e Conf. Intl. Vision par ordinateur, Berlin, pp. 121-128. Un CNN 2-dimensionnel dont les couches de sous-échantillonnage utilisent le Max-Pooling (qui est devenu très populaire) au lieu de l'averaging spatial de Fukushima [1].

[9] En 2011, le CNN rapide et profond basé sur GPU appelé DanNet (7+ couches) a atteint la première performance surhumaine dans un concours de vision par ordinateur. Voir l'aperçu : "2011 : DanNet déclenche la révolution des CNN profonds."

[10] Comment 3 lauréats du prix Turing ont republié des méthodes et des idées clés dont les créateurs n'ont pas été crédités. Rapport technique IDSIA-23-23, Swiss AI Lab IDSIA, 14 déc. 2023. Voir aussi la vidéo YouTube pour la cérémonie de remise du prix Bower 2021 : J. Schmidhuber loue Kunihiko Fukushima.

346,79K

Meilleurs

Classement

Favoris