Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Interessant. Warum wird Fukushima nicht so gefeiert wie westliche KI-Forscher?

3. Aug., 22:05

Wer hat die konvolutionalen neuronalen Netzwerke (CNNs) erfunden?

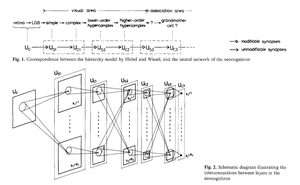

1969: Fukushima hatte CNN-relevante ReLUs [2].

1979: Fukushima hatte die grundlegende CNN-Architektur mit Faltungsschichten und Downsampling-Schichten [1]. Die Berechnung war 100 x teurer als 1989 und eine Milliarde x teurer als heute.

1987: Waibel wandte Linnainmaa's Backpropagation von 1970 [3] auf gewichtete TDNNs mit eindimensionalen Faltungen [4] an.

1988: Wei Zhang et al. wandten "moderne" backprop-trainierte zweidimensionale CNNs auf die Zeichenerkennung an [5].

All dies wurde in Japan von 1979 bis 1988 veröffentlicht.

1989: LeCun et al. wandten CNNs erneut auf die Zeichenerkennung (Postleitzahlen) an [6,10].

1990-93: Fukushimas Downsampling basierend auf räumlicher Averaging [1] wurde durch Max-Pooling für 1-D TDNNs (Yamaguchi et al.) [7] und 2-D CNNs (Weng et al.) [8] ersetzt.

2011: Viel später machte mein Team mit Dan Ciresan Max-Pooling-CNNs wirklich schnell auf NVIDIA-GPUs. 2011 erzielte DanNet das erste übermenschliche Mustererkennungsergebnis [9]. Eine Zeit lang genoss es ein Monopol: von Mai 2011 bis September 2012 gewann DanNet jede Bildverkennungschallenge, an der es teilnahm, 4 davon hintereinander. Zugegeben, dies war jedoch hauptsächlich eine Frage der Technik und der Skalierung der grundlegenden Erkenntnisse aus dem vorherigen Jahrtausend, profitierend von viel schnellerer Hardware.

Einige "KI-Experten" behaupten, dass "CNNs zum Laufen zu bringen" (z.B. [5,6,9]) ebenso wichtig war wie ihre Erfindung. Aber "sie zum Laufen zu bringen" hing weitgehend davon ab, ob Ihr Labor reich genug war, um die neuesten Computer zu kaufen, die erforderlich waren, um die ursprüngliche Arbeit zu skalieren. Es ist dasselbe wie heute. Grundlagenforschung vs. Ingenieurwesen/Entwicklung - das R vs. das D in F&E.

REFERENZEN

[1] K. Fukushima (1979). Neuronales Netzwerkmodell für einen Mechanismus der Mustererkennung, der nicht von der Position beeinflusst wird — Neocognitron. Trans. IECE, Bd. J62-A, Nr. 10, S. 658-665, 1979.

[2] K. Fukushima (1969). Visuelle Merkmalsextraktion durch ein mehrschichtiges Netzwerk von analogen Schwellenwert-Elementen. IEEE Transactions on Systems Science and Cybernetics. 5 (4): 322-333. Diese Arbeit führte die rectified linear units (ReLUs) ein, die jetzt in vielen CNNs verwendet werden.

[3] S. Linnainmaa (1970). Masterarbeit, Univ. Helsinki, 1970. Die erste Veröffentlichung über "moderne" Backpropagation, auch bekannt als der umgekehrte Modus der automatischen Differenzierung. (Siehe Schmidhubers bekannte Übersicht über Backpropagation: "Wer hat Backpropagation erfunden?")

[4] A. Waibel. Phonemerkennung mit zeitverzögerten neuronalen Netzwerken. Treffen der IEICE, Tokio, Japan, 1987. Backpropagation für ein gewichtete TDNN mit eindimensionalen Faltungen.

[5] W. Zhang, J. Tanida, K. Itoh, Y. Ichioka. Shift-invariante Mustererkennung neuronales Netzwerk und seine optische Architektur. Proc. Jahrestagung der Japan Society of Applied Physics, 1988. Erstes backpropagation-trainiertes zweidimensionales CNN, mit Anwendungen zur Erkennung englischer Zeichen.

[6] Y. LeCun, B. Boser, J. S. Denker, D. Henderson, R. E. Howard, W. Hubbard, L. D. Jackel: Backpropagation angewendet auf die Erkennung handgeschriebener Postleitzahlen, Neural Computation, 1(4):541-551, 1989. Siehe auch Abschnitt 3 von [10].

[7] K. Yamaguchi, K. Sakamoto, A. Kenji, T. Akabane, Y. Fujimoto. Ein neuronales Netzwerk zur sprecherunabhängigen isolierten Worterkennung. Erste Internationale Konferenz über Sprachverarbeitung (ICSLP 90), Kobe, Japan, Nov 1990. Ein eindimensionales konvolutionales TDNN, das Max-Pooling anstelle von Fukushimas räumlicher Averaging [1] verwendet.

[8] Weng, J., Ahuja, N., und Huang, T. S. (1993). Lernen von Erkennung und Segmentierung von 3-D-Objekten aus 2-D-Bildern. Proc. 4. Intl. Konferenz über Computer Vision, Berlin, S. 121-128. Ein zweidimensionales CNN, dessen Downsampling-Schichten Max-Pooling verwenden (was sehr beliebt geworden ist) anstelle von Fukushimas räumlicher Averaging [1].

[9] 2011 erzielte das schnelle und tiefe GPU-basierte CNN namens DanNet (7+ Schichten) die erste übermenschliche Leistung in einem Computer Vision-Wettbewerb. Siehe Übersicht: "2011: DanNet löst die Revolution der tiefen CNN aus."

[10] Wie 3 Turing-Preisträger wichtige Methoden und Ideen, deren Schöpfer sie nicht anerkannten, neu veröffentlichten. Technischer Bericht IDSIA-23-23, Swiss AI Lab IDSIA, 14. Dez 2023. Siehe auch das YouTube-Video zur Bower Award Ceremony 2021: J. Schmidhuber lobt Kunihiko Fukushima.

26,2K

Top

Ranking

Favoriten