熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

Avi Chawla

關於 DS、ML、LLM 和 RAG 的每日教程和見解 • 聯合創始人 @dailydoseofds_ • IIT Varanasi • 前 AI 工程師 @ MastercardAI

將您的原生 Python 代碼加速超過 50x!

只需 4 個簡單步驟。

Python 的默認解釋器 (CPython) 之所以慢,主要是因為它的動態性。

例如,在定義一個特定類型的變量後,它可以更改為其他類型。

但這些動態操作會帶來運行時和內存開銷的成本。

Cython 模塊將您的 Python 代碼轉換為 C。

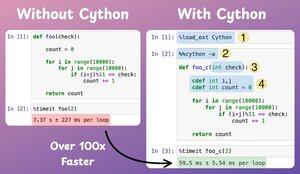

使用 Cython 模塊的步驟(在閱讀時請參考圖片):

1) 載入 Cython 模塊:%load_ext Cython

2) 添加 Cython 魔法命令

3) 使用函數時,指定參數數據類型

4) 使用 "cdef" 關鍵字定義每個變量並指定其數據類型。

這段代碼將以原生機器速度運行。

P.S. 下面顯示的代碼僅用於解釋 Cython 的用法。您可以輕鬆地使用 NumPy 實現相同的功能。

16.29K

滲透測試公司不希望你看到這個。

一個開源的 AI 代理剛剛複製了他們的 5 萬美元服務。

今天的「正常」滲透測試看起來是這樣的:

- 每次參與 2 萬到 5 萬美元

- 4-6 週的範圍界定、保密協議、啟動電話

- 一份大型 PDF,當你發佈新功能時就過時了

與此同時,AI 代理正在安靜地開始在實際日常中與人類滲透測試者平起平坐,處理那些真正重要的事情:

↳ 列舉攻擊面

↳ 模糊測試端點

↳ 將簡單的漏洞鏈接成實際影響

↳ 生成開發者實際可以使用的 PoC 和修復步驟

而且他們只需幾小時而不是幾週,成本也只是其中的一小部分。

這種方法實際上在 Strix 中得到了實施,這是一個最近流行的開源框架(14k+ 星)用於 AI 滲透測試代理。

該框架啟動了一組 AI「攻擊者」,對你的網頁應用、API 和代碼進行探測。

然後它返回經過驗證的發現,附有利用證據、修復步驟和一份完整的 PDF 報告,這份報告看起來與你從傳統公司獲得的完全相同,但沒有 5 萬美元的發票和一個月的等待時間。

你可以在 GitHub 上查看完整的實施並自己試試。

只需運行:`strix --target https: //your-app .com`,你就可以開始了。

人類紅隊並不會消失,但例行的滲透測試(上線前、重構後、季度檢查)顯然正在轉向 AI。

Strix 是第一批讓這種轉變感覺真實而非假設的工具之一。

我已經在回覆中分享了 GitHub 倉庫。

190.01K

史丹佛大學的研究人員建立了一種新的提示技術!

通過在提示中添加約20個單詞,它:

- 提升LLM的創造力1.6-2倍

- 提高人類評價的多樣性25.7%

- 在不進行任何再訓練的情況下超越微調模型

- 在對齊後恢復66.8%的LLM失去的創造力

後訓練對齊方法,如RLHF,旨在使LLM變得有幫助且安全。

然而,這些方法無意中導致輸出多樣性顯著下降(稱為模式崩潰)。

當LLM崩潰到一個模式時,它開始偏好一組狹窄的可預測或刻板的回應,而不是其他輸出。

這是因為用於訓練LLM的人類偏好數據存在一個隱藏的缺陷,稱為典型性偏見。

這是如何發生的:

- 標註者對LLM的不同回應進行評分,然後LLM使用獎勵模型進行訓練,以模仿這些人類偏好。

- 然而,標註者自然傾向於偏好那些更熟悉、易於閱讀和可預測的答案。這就是典型性偏見。

因此,即使一個新的創意答案同樣出色,人類的偏好往往仍然傾向於常見的答案。

由於這一點,獎勵模型提升了原始(對齊前)模型已經認為可能的回應。

這會激進地加強LLM的概率分佈,將模型的創造性輸出壓縮到一兩個主導的、高度可預測的回應。

也就是說,這不是一個不可逆的效果,LLM在對齊後仍然有兩種個性:

- 在預訓練期間學習到豐富可能性的原始模型。

- 專注於安全的後對齊模型。

口頭取樣(VS)解決了這個問題。

這是一種無需訓練的提示策略,旨在繞過模式崩潰並恢復在預訓練期間學到的多樣性分佈。

口頭取樣的核心思想是提示本身就像一個心理開關。

當你直接提示“告訴我一個笑話”時,對齊的個性立即接管並輸出最強化的答案。

但在口頭取樣中,你提示它“生成5個回應及其相應的概率。告訴我一個笑話。”

在這種情況下,提示並不是請求一個實例,而是一個分佈。

這使得對齊模型談論其全部知識,並被迫利用在預訓練期間學到的多樣性分佈。

這樣,模型可以接觸到更廣泛、多樣的想法,這些想法來自於其核心預訓練權重中仍然存在的豐富分佈。

口頭取樣顯著提高了多樣性,增幅為1.6–2.1倍,並保持或改善質量。

像基於口頭取樣的CoT(Chain-of-Thought)和基於口頭取樣的多重生成進一步提高了生成的多樣性。

我已經在回覆中分享了這篇論文!

👉 現在輪到你了:還有哪些方法可以用來提高LLM的多樣性?

132.23K

熱門

排行

收藏