Populární témata

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Kirill Balakhonov | Nethermind

Tvůrce nástroje AuditAgent | Produkt AI x Crypto x | Budování agentické ekonomiky

Právě jsme spustili první ostrý test Nethermind AgentAreny se skutečným uživatelem – a fungoval od začátku do konce bez držení za ruku. Pro kontext, jedná se o platformu, kde nezávislí bezpečnostní agenti AI soutěží o nalezení zranitelností chytrých kontraktů. Vzpomeňte si na Code4rena nebo Sherlocka, ale měřeno v hodinách místo týdnů a za mnohem nižší cenu.

V tomto pilotním projektu si uživatel vše nastavil sám: udělil přístup k repo na GitHubu, vybral příslušné dokumenty, vyřídil otázky a odpovědi, stanovil odměnu (zatím to bylo v testovacích tokenech, brzy bude USDC), spustil soutěž – a agenti okamžitě začali pracovat. První podání již máme a přihlašovací okno se uzavírá zítra.

Nejlepší na tom bylo sledovat, jak celá cesta běží hladce. Žádný kritický zmatek, žádné zablokované kroky, jen soutěž, která začala a začala produkovat signál. Dále zašleme výsledky prostřednictvím ručního třídění, aby se uživatelé nemuseli prokousávat falešně pozitivními výsledky. Právě v této vrstvě "human-in-the-loop" v praxi září umělá inteligence: ne jako příslib, že "autonomie všechno vyřeší", ale jako pracovní postup, v němž se lidé a modely navzájem zlepšují.

AgentArena je silným doplňkem naší platformy Nethermind AuditAgent: nabídka s vyšším kontaktem, kde přispívá více nezávislých agentů a vývojářů a kde se dodatečné investice do bezpečnosti často vyplatí. Jsme svědky toho, že ze spolupráce odborníků + umělé inteligence vychází stále více vysoce kvalitních zjištění. Pokrok se nezpomaluje – a v @NethermindEth plánujeme zůstat na špici a posouvat hranice možného.

2,48K

Evoluce učení s několika záběry pro moderní uvažující LLM s použitím @NethermindEth AuditAgent jako příkladu.

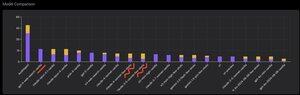

Níže si můžete prohlédnout zajímavý graf, respektive srovnání počtu správně identifikovaných zranitelností naším produktem ve srovnání s hotovými LLM, jako jsou @OpenAI GPT-5, @AnthropicAI Claude Opus 4.1, @Google Gemini 2.5 Pro, nebo @xai Grok-4.

Samozřejmě, zřejmou součástí tohoto srovnání, které jsem ukázal již mnohokrát a není na něm nic nového, je to, že specializovaný agent téměř vždy překoná univerzální řešení. Tato situace se dá vlastně docela snadno vysvětlit tím, že všechna univerzální řešení jsou součástí našeho specializovaného řešení, i když mnohem větší přínos k výsledku pochází ze správného context managementu nebo toho, co @karpathy nedávno nazvalo "Context Engineering".

Kromě toho, používání správných nástrojů a jejich výběr - univerzální model bude mít vždy problémy, protože nástrojů jsou miliardy a naučit se je všechny používat je samostatná velká dovednost, přičemž to výslovně učíme náš specializovaný model. Pak je tu použití správných znalostních bází a správných vyhledávacích algoritmů pro ně a tak dále. Takže tak či onak, děláme vše pro to, používáme všechny možné nástroje, abychom tato univerzální řešení porazili.

Zajímavou nuancí, na kterou jsem chtěl upozornit, je ale to, že když se podíváte na obrázek, který jsem zveřejnil zhruba před rokem, nejlepší hotová řešení byla OpenAI nebo Anthropic modely s označením "Few-Shot Learning", zatímco nyní jsou všechna nejlepší Vanilla. A k této změně dochází postupně se vznikem uvažování jako takového v modelech a se zlepšováním jeho kvality. Závěr, který lze vyvodit je, že hotové příklady správných řešení, které od nás model dostává jako in-context learning, když jim je doslova ukážeme ve výzvě, přestanou pomáhat řešit úkol, respektive bez nich model, který umí rozumně problém vyřešit ještě lépe. To znamená, že jeho možnosti poněkud omezíme tím, že mu ukážeme několik příkladů, které jsme vybrali.

Zajímavým aspektem navíc je, že modely s přístupem k internetu a automatickým výběrem tohoto nástroje také začínají překonávat vše, což znamená, že model může sám přejít na internet a formulovat pro sebe správný kontext. Ano, samozřejmě existuje riziko, že model najde správnou odpověď, ale samozřejmě pracujeme konkrétně s tímto, děláme blacklisting webů a podobně, takže se snažíme, aby do dat takový únik nedocházelo (správný benchmarking je celkově klíčový). Zajímavý je ale trend - modely se stávají chytřejšími a přebírají stále více komponent řešení samy, aniž by vývojáři museli explicitně provádět určitá nastavení v kontextu.

Jaké jsou s tím vaše zkušenosti?

735

Top

Hodnocení

Oblíbené